Zdjęcia osób, które nie istnieją lub filmy ludzi mówiących rzeczy, których nigdy nie powiedzieli. Na tym polega technologia deepfake. Grupa naukowców z Politechniki Krakowskiej otrzymała rządowe dofinansowanie w wysokości prawie 4 milionów złotych na opracowanie algorytmu, który wykrywa takie fałszywe zdjęcia i nagrania. Technologia deepfake może być bardzo niebezpieczna.

Na przykład nawiązując do aktualnie napiętych stosunków na linii Rosja i Świat Zachodni, co by się stało, gdyby pojawiło się nagranie Prezydenta Joe Bidena, który mówi, że jest gotowy do ataku w każdej chwili czy tego typu groźby - tłumaczy szef zespołu badawczego Profesor Michał Bereta.

Algorytm, który będzie wykrywał fałszywki jest oparty o te same mechanizmy, które je tworzą. Deepfake-i nie są doskonałe więc naukowcy budują system, który wykrywa te wygenerowane komputerowo niedoskonałości.

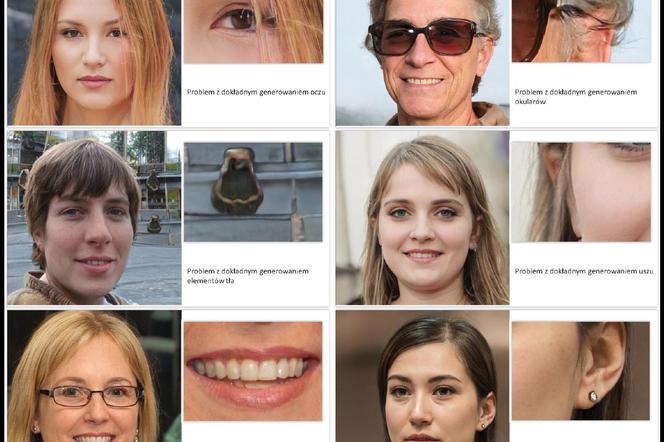

Tu są różne przykłady. Czasami szczegóły twarzy jak na przykład oko, które nie jest wygenerowane dokładnie, widać że się zlewa z włosami. Okulary i tego typu szczegóły, oprawki, które nie są przykryte włosami tylko jakby płynnie przechodzą we włosy. Sieć neuronowa nie zawsze potrafi rozróżnić te dwa obiekty - mówi Prof. Bereta.

Docelowo system ma być udostępniony w sieci na bazie subskrypcji i każdy użytkownik będzie mógł w Internecie zweryfikować daną fotografię, film bądź nagranie audio.

Konkrus grantowy, który wygrali naukowcy z PK jest rozpisany na 3 lata i planowo do marca 2025 roku system powinien być gotowy do użycia. Potem jest przewidziany dodatkowy okres na wdrożenie komercyjne.